AIは「インテリジェンスに対する関税」に他ならない→誰かがそのコストを支払う羽目に

2025年11月1日 14:30

AIがビジネスに与える財務的なインパクトを理解する場合、(これはトランプ関税に似ていて…誰かがそのコストを払う羽目に陥る)と考えると理解しやすいでしょう。

すでにSaaS(ソフトウェア・アズ・ア・サービス)会社の一部は自社のサービスにAIを追加しています。

実際に、それがどう実現されているか? ですが、たとえばGPT-4のような外部のAPIを使うことでそれを実現している場合があります。カスタマー・サポートなどがその例です。チケット(リクエスト)に対する自動化された回答がそれです。

もう少し深いレベルでのAIとの統合のしかたは、ワークフローの中にAIをエンベッドするやり方です。SaaSが持っている独自データをセキュアーで、なおかつストラクチャされたインターフェースによって取り出し、活用するわけです。

三番目の、最も深いAIのアダプションのやり方は、SaaS企業が独自のモデルをトレーニングし、自社のプロプライエタリでドメイン・スペシフィックなデータ、たとえば契約書やコードベースを独自のインフラストラクチャ、もしくはプライベート・クラウドで走らせる方法です。

SaaS企業がどのようなやり方を選ぼうが、演算コスト(Cost of compute)が「関税」のようにのしかかってきます。なぜならAIによる便利さの提供には必ず限界的コスト(Marginal cost)が伴うからです。従来のSaaSのロジックでは限界的コストがゼロに限りなく近かったことと対比すると、これは大きな負担増と言えます。

SaaS顧客の1クエリに対しAIチャットを使って回答するコストが仮に0.5¢だとすれば、10万座席あるSaaSの顧客が1日10クエリを出せばそれは$5,000のコスト増になります。

SaaS企業はいろいろな方法でこのコスト増に対応しています。カンヴァの場合、従量課金を取り入れています。マンデードットコムの場合、プレミアム・ユーザーのみに一部のAIツールの使用を許しています。ラマ3のような、安いオープンソースで済ませるSaaSもあります。さらに短いプロンプト、アウトプットのキャッシングなどでコスト削減している場合もあります。

いずれにせよ、SaaS企業は、気をつけていないとグロスマージンがこれまでの70%から、下手すると40~60%くらいに落ちてしまうリスクがあります。SaaS企業にとってAIブームは「歓迎せざる新展開」なのです。

言い換えれば、AIを導入することで、より高いARPUを実現することが出来るなら、SaaS企業にとってAIは朗報だけど、そうでなければAIはコストばかりが増えるわけです。

ARPUが増えるということは……それはユーザーがAIのコストを負担していることに他なりません。しかしARPUが増えないのであれば、それはSaaS企業がコスト増をマージンを犠牲にすることで吸収していることを意味します。このダイナミズムは、たとえば「トランプ関税を誰が負担する?」という議論に合い通じるものがあるわけです。

AIへのクエリは限界的コストであり、誰かがそのコストを負担しなければいけない……これは「インテリジェンスに対する関税」なのです。

関税は商品が国境を超えたとき発生します。コンピュートに対する限界的コストはそれがシリコン、すなわち半導体を通過したときに発生するわけです。

関税が導入されると貿易の姿が「ひん曲がる」のと同様に、SaaS企業がAIを導入するとソフトウェアのデザインの仕方が「ひん曲がる」のです。なぜならコストを吸収する方法を考えざるを得ないので。

関税がサプライチェーンの在り方に変化をもたらしたように、AIの限界的コストはSaaSモデルの最適化のための変更を強いることになります。

SaaS企業がコストの極小化を目指す際、モデル間でのアービトラージという方法を採る(チャットGPT4対ラマ3など)こともあるし、AIのワークロードに応じてクラウド・サービスを「いいとこ取り(cherry-picking)」することもあるでしょう。

このコスト極小化の努力は、とりもなおさずAIファクトリーのビジネスがコモディティ・ビジネスであることを示唆しています。

AIファクトリーでは、GPU、電力、冷却装置などは「素材(raw material)」と捉えるべきです。そしてアウトプットは従量制(=トークン費消、クエリ毎、時間制など)で課金となります。するとインテリジェンスの生産は、発電と同じようにスケールが問題になり、小口の切り売りでは儲からなくなるわけです。

このコモディタイゼーションはエヌビディア、ブロードコム、AMDなどのチップ・レベルでも起きていますし、次にAWS、アジュール、コアウィーブなどのクラウド・インフラストラクチャでも起きるはずです。

そういうことを熟知しているオープンAIは、すでに「AIモデルの会社」から「AIの工業オペレーター」へと戦略転換しています。そこでは「工場である以上、最も価格競争力のあるコスト体質を心がけないといけない」のです。

そこで半導体のデザイン(エヌビディア、AMD、ブロードコム)からホスター(オラクル)の選択まで、すべてを新しくデザインしています。コスト削減の具体的な目安は;

GPUデザインを効率よくする +15~20%

インフィニバンドもしくはイーサネットのファブリックの最適化 +10%

ソフトウェア、コンパイラの最適化 +10%

ワークロードのスケジュールの最適化 +5%

冷却装置の最適化 +5%

ホスティング先の最適化 +10%

塵も積もれば山となるで、これらにより営業費用を大幅に削減できるわけです。

その証拠にオープンAIは創業以来、以下の企業から資金を調達しました;

マイクロソフト 130億ドル (2019年から2023年にかけて)

ソフトバンク1000億ドル(データセンター建設)

ソフトバンク400億ドル(オープンAIへの出資)

オラクル3000億ドル(データセンター建設)

UAE 200億ドル(データセンター建設)

エヌビディア 1000億ドル(オープンAIへの出資)

合計5730億ドル、うち自前(パートナー含む)のデータセンター投資は4200億ドルです。

一方、オープンAIは次の企業にビジネスを発注しています;

マイクロソフト 130億ドル(ほぼ終了)

コアウィーブ 220億ドル

オラクル 3000億ドル

エヌビディア 半導体を発注(1000億ドル)

AMD 半導体を発注(不明)

合計4350億ドル。

これが何を意味するか? ですが、オープンAIは自前(パートナーを含む)のデータセンターを建設し、もっぱらそれを使用しているということです。その背景には熾烈なコモディタイゼーションにいまから備えるという意味合いがあります。

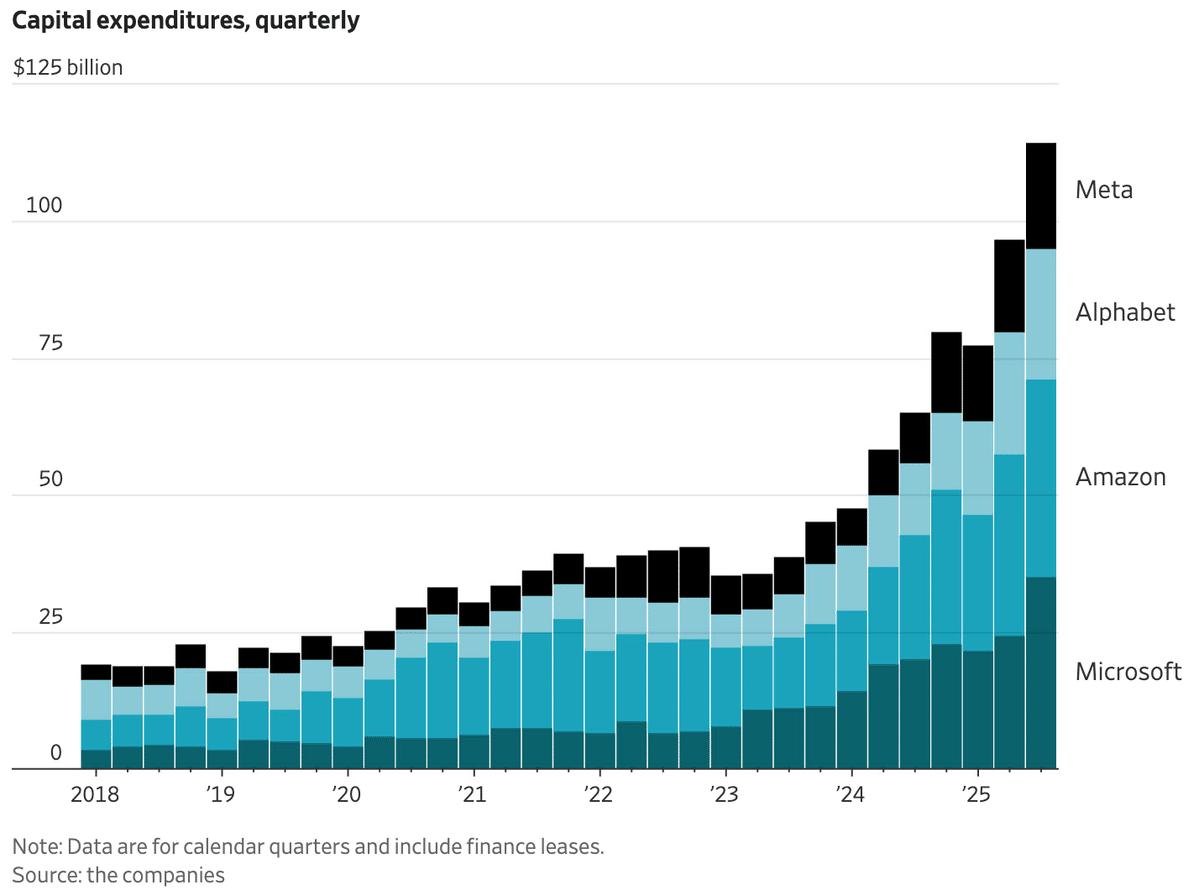

言い換えればオープンAIは今後、マイクロソフト・アジュール、アマゾンAWS、グーグル・クラウドを起用する可能性は低いということです。一方、マイクロソフト、アマゾン、グーグル・クラウドなどは年間4000億ドルにのぼる設備投資をしていますが、彼らはオープンAI以外の顧客を探してこないといけないことを意味します。

彼らが置かれた立場は「設備投資は既存顧客をつなぎとめるために待ったナシだが…設備投資でより高いリターンが得られる保証はまったくない」状態に置かれているのです。

折角購入したGPUは日に日にコスト競争力を失いますし、クラウドサービスの価格設定は競争に晒されます。さらに設備稼働率を高く維持できる保証はないです。

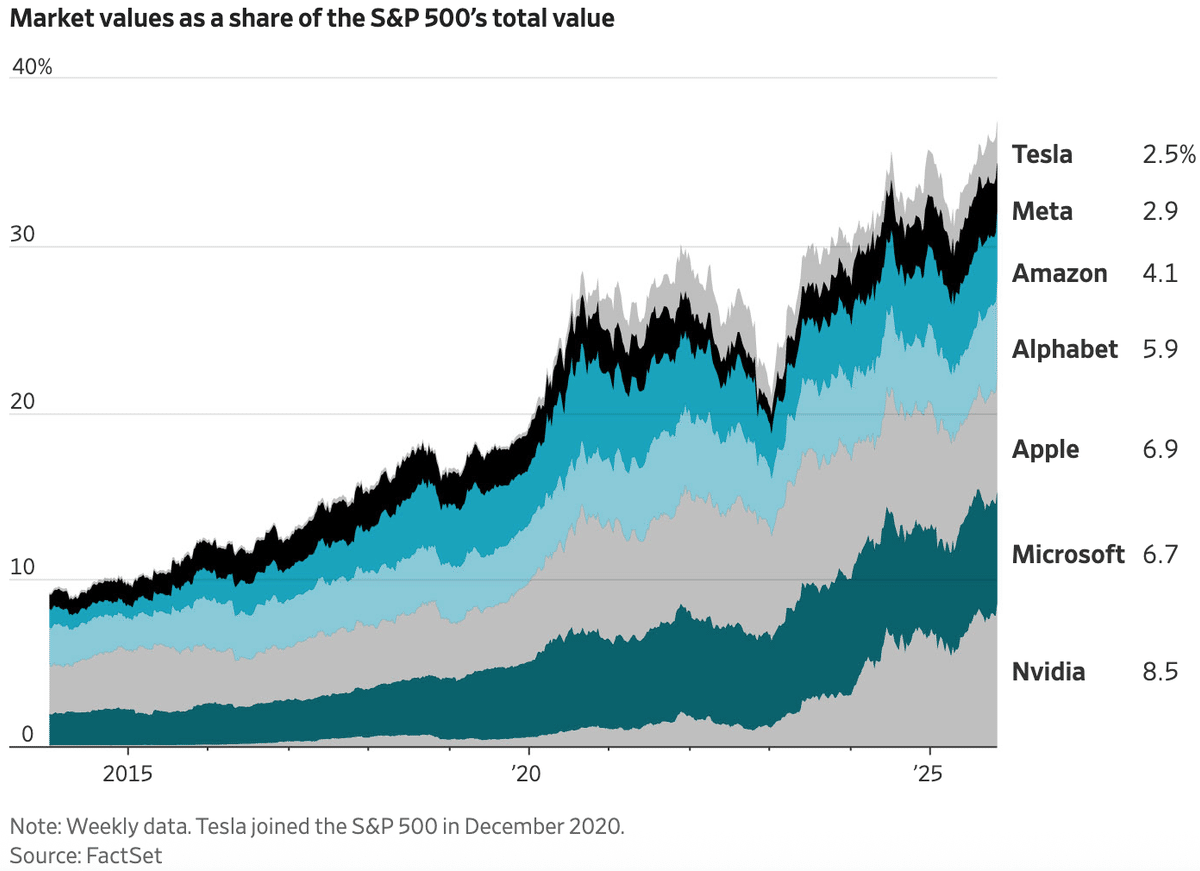

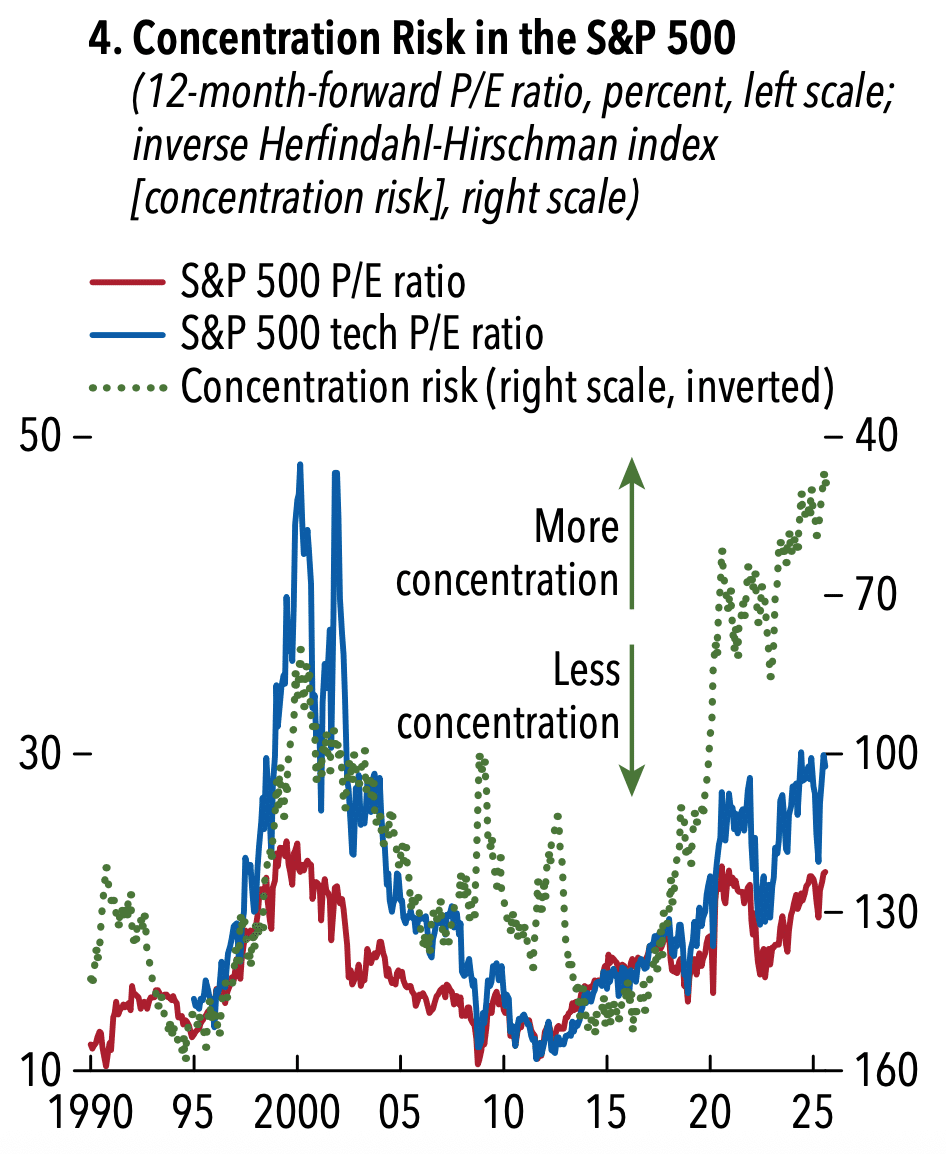

株式市場に目を転じるとS&P500に占めるMag7の比率は35%を超えています。

わずか7銘柄に米国の時価総額がこれほど集中したことはかつてありませんでした。

投資家は、いまはクラウドサービス売上高の伸びだけに注目しています。そして今回の決算でもAWSは+20%、アジュールは+40%という感じで、それは良く伸びています。しかし設備投資は、いずれ償却コストというカタチでEPSを圧迫します。いずれ投資家はクラウドサービスの売上高伸び率から、利益の伸長にフォーカスを移してゆくと考えられます。