超知能

2025年10月7日 03:20

**超知能(Superhuman AI)**とは人間の頭脳を遥かに超えるAIを指します。

それは「アインシュタインの百万倍賢く、しかも眠らないAI」と形容されます。

比較のために汎用人工知能(AGI: Artificial General Intelligence)は「人間の出来る知的タスクならすべてこなせるAI」を指し、推論、学習、創造、情操の理解、適応能力の全部で人間に匹敵するAIがこれに相当します。

これに対し超知能は人間が概念すら把握できないような込み入った事象に関する問題解決を得意とし再帰的に超知能本人の考え方やアプローチですらカイゼンしてしまう能力を具備しています。たとえばグローバル経済が全体として最も高い成長率を達成するために個々の国の政策や企業の行動に至るまですべてを最適化する指示を出せるようなAIと言えます。

イライザー・ユドコウスキーは超知能は必然的に人間と競争し(いわゆる「ハードになる」)超知能自身の「保存」のため、人類を敵に回すリスクがあると論じています。

AI関係者の間では、AGIが完成するタイミングとして2027年頃だろうとする説と、2047年くらいまでかかるという説があります。

一方、超知能はそれより数年から十数年遅れて登場すると考えられています。すると早くて2030年、ひょっとすると2060年くらいまでかかるかも知れないのです。

ユドコウスキーは超知能が出てくれば人類は死滅すると論じています。その根拠として超知能は自分のソフトウェアを再帰的にどんどんカイゼンできるし、自分の判断で演算に必要なリソースをどこかから調達してくることが出来るし、人間が超知能を制御しようとしてもそれを無力化するだけの知恵をもっているからだとしています。

ところで全ての演算(compute)は、タダではありません。無料チャットGPTのように一見するとタダで提供されているようなものでも、実際には莫大な経費をかけてそれが実現されているわけです。

GPUやカスタムAIアクセラレーターはタダではないしデータセンターで消費する電力も高価です。液冷システムも高価だし、われわれがチャットGPTのAPIを使って「AIガールフレンド」のようなものを作った場合でも、APIトークンによって課金メーターが「ちゃりんちゃりん」と動くのです。

いまはマグニフィセント・セブンのような企業が自腹を切ってAIに投資しているので「真のコスト」は見える化されていません。しかし超知能が人間に脅威となれば『2001年宇宙の旅』のようにAIデータセンターをシャットダウンしないといけなくなる場面があるかも知れません。

ユドコウスキーは超知能が悪魔化して金融システムをハッキングする、デジタル・アセットを盗むというようなことを通じ、演算に必要な一切合切の資源を取りにゆくと論じています。

ただ現実問題としてはブラックウェルにバグがあり出荷が遅れた例に見られるようにAIのツールを提供している企業は毎日のように限界、ないしはボトルネックに直面しています。また周波数帯域やレイテンシーの問題も超知能が本領を発揮するような局面では深刻なゲーティング・ファクターになると思われます。またAI投資の大部分は資本市場がいま「熱狂」しているからこそ安く調達できているわけで、市民が超知能を脅威と感じ始めれば投機熱は冷めます。

有り体に言えばAIはそれに投資を行っているお金の出し手の経済的目的ないしは目論見の下僕というのが現状です。

もっとわかりやすい言い方に直せば、超知能が「ハードになる」前に、まず誰かが電気代を払わないといけないということです。

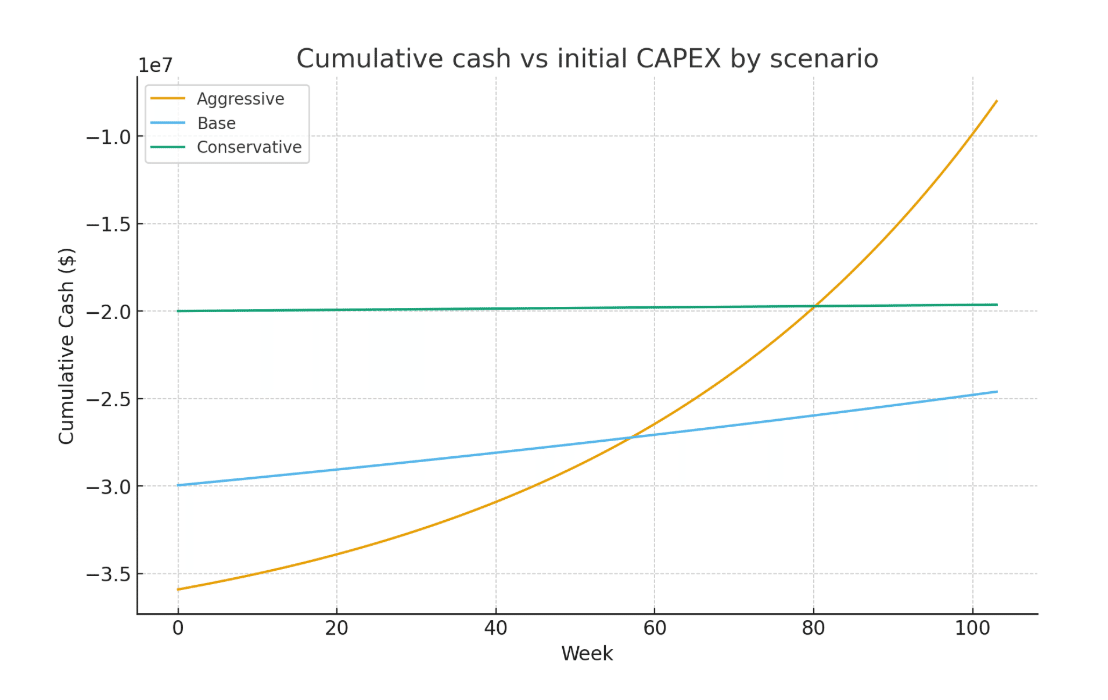

もしAIの課金が上手く行きGPU使用時間当たりの売上高が急成長すれば(上の図のAggressiveシナリオ)再投資の原資となるキャッシュもどんどん積み上がります。

しかし先行投資に対してカツカツの売上高しかもたらさなかった場合、AI投資は自ずとスローダウンし、超知能どころではなくなるのです。

その時出現するのは「白い象」です。